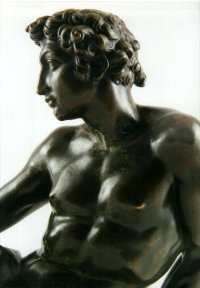

Felice Palma. Massa 1583-1625. Collezione / Collection.

Testi di Claudio Casini, Andrei Cristina, Ciarlo Nicola, Federici Fabrizio e Sara Ragni.

Testo Italiano e Inglese.

Pontedera, 2024; ril. in cofanetto, pp. 289, ill. b/n e col., tavv. b/n e col., cm 24,5x34.

(L'Oro Bianco. Straordinari Dimenticati. The White Gold Forgotten Masters).

prezzo di copertina: € 160.00

|

Libri compresi nell'offerta:

Felice Palma. Massa 1583-1625. Collezione / Collection.

Testi di Claudio Casini, Andrei Cristina, Ciarlo Nicola, Federici Fabrizio e Sara Ragni.

Testo Italiano e Inglese.

Pontedera, 2024; ril. in cofanetto, pp. 289, ill. b/n e col., tavv. b/n e col., cm 24,5x34.

(L'Oro Bianco. Straordinari Dimenticati. The White Gold Forgotten Masters).

OMAGGIO (prezzo di copertina: € 160.00)

Le botteghe del marmo

Testo Italiano e Inglese.

Ospedaletto, 1992; ril., pp. 153, 10 ill. b/n, 60 ill. col., cm 24x29.

(Immagine).

OMAGGIO (prezzo di copertina: € 34.49)

Museo Stefano Bardini. I Bronzetti e gli Oggetti d'Uso in Bronzo

A cura di Nesi A.

Firenze, 2009; br., pp. 191, 102 ill. b/n, 7 ill. col., cm 17x24,5.

(Museo Stefano Bardini).

OMAGGIO (prezzo di copertina: € 30.00)

Bronzetti e Rilievi dal XV al XVIII Secolo

Bologna, 2015; 2 voll., ril. in cofanetto, pp. 729, ill., tavv. col., cm 21,5x30,5.

OMAGGIO (prezzo di copertina: € 90.00)

Prima che sia troppo tardi. Perché la superintelligenza artificiale è una minaccia per l'umanità

Yudkowsky Eliezer - Soares Nate

Arnoldo Mondadori Editore

Traduzione di Allegra Panini.

Segrate, 2010; cartonato, pp. 300, cm 14,8x22,2.

(Orizzonti).

collana: Orizzonti

ISBN: 88-04-80310-X - EAN13: 9788804803102

Testo in:

Peso: 0.378 kg

Luoghi Magici di Bologna. Vol. 1: la Piazza e i Suoi Simboli Segreti

Elementi di tecnologia ceramica. Tra scienza, arte e innovazione